目次

DRT-o1: Optimized Deep Reasoning Translation via Long Chain-of-Thought

この論文は、長い思考過程を活用した最適化された深層推論翻訳モデル(DRT-o1)を提案し、特に比喩や隠喩を含む文学的なテキストの機械翻訳におけるその効果を示しています。

DRT-o1は、比喩や隠喩を含む文学作品の翻訳において、マルチエージェントフレームワークを使用して長い思考を模倣し、翻訳の質を向上させる革新的なアプローチを提案しています。

論文:https://arxiv.org/abs/2412.17498

リポジトリ:https://github.com/krystalan/DRT-o1

以下は、LLMを用いてこの論文の内容を要約したものになります。

概要

最近、O1型モデルが登場し、数学やコーディングタスクなどの推論タスクにおける長い思考の連鎖(CoT)の効果を示す代表例となっています。本論文では、長いCoTの成功をニューラル機械翻訳(MT)に持ち込む試みとしてDRT-o1を紹介します。特に、比喩や隠喩を含む文学作品の翻訳は、文化的な違いから実際には非常に困難です。このような場合、直訳では意図された意味を効果的に伝えることができません。プロの人間翻訳者でさえ、翻訳プロセス全体で意味論を保持するために相当な思考を要します。

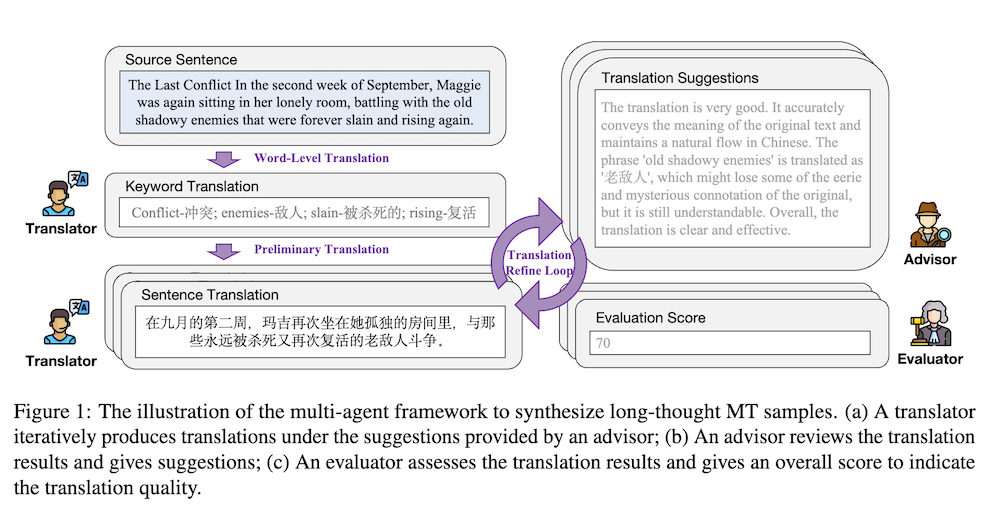

機械翻訳におけるLLMの長い思考能力を模倣するために、まず既存の文学作品から比喩や隠喩を含む文を抽出し、それらの文を長い思考を介して翻訳するためのマルチエージェントフレームワークを開発します。このマルチエージェントフレームワークでは、翻訳者がアドバイザーから提供された提案に基づいて、ソース文を反復的に翻訳します。長い思考の効果を確保するために、各ラウンドで翻訳の質を定量化するための評価者も用います。この方法で、数万件の長い思考を伴うMTデータを収集し、DRT-o1の訓練に使用します。Qwen2.5とLLama-3.1をバックボーンとして使用することで、DRT-o1モデルは機械翻訳中の思考プロセスを学習し、従来のLLMや既存のO1型LLMを上回る性能を示します。

DRT-o1: 最適化された深層推論翻訳に関する研究

本論文では、DRT-o1という新たな機械翻訳手法を提案し、文学作品における比喩や隠喩の翻訳における課題に対処します。この手法は、特に文化的な違いによって生じる翻訳の難しさを考慮し、長い思考過程(Chain-of-Thought, CoT)を活用することを目的としています。

1. 研究の背景

近年、O1類似モデルが登場し、長い思考過程の効果がさまざまなタスクで示されています。本研究では、この長い思考過程の成功を機械翻訳に応用することを試み、特に比喩的な表現の翻訳において意図した意味を効果的に伝える新しいアプローチを提案します。

2. 方法論

DRT-o1の実装には以下のステップが含まれます。

2.1 データ収集

既存の文学作品から比喩や隠喩を含む文を抽出し、翻訳が難しい文のデータセットを構築します。このデータは、数万件に及ぶ長い思考過程を含む機械翻訳データの基盤となります。

2.2 マルチエージェントフレームワークの開発

翻訳プロセスを支援するために、以下の三つのエージェントを持つマルチエージェントフレームワークを構築します:

- 翻訳者エージェント: ソース文を反復的に翻訳します。

- アドバイザーエージェント: 翻訳者に対して提案を行い、翻訳の質を向上させます。

- 評価者エージェント: 各ラウンドの翻訳の効果を定量化します。

このフレームワークを通じて、長い思考過程をシミュレートし、効果的な翻訳を実現します。

2.3 モデルの訓練

DRT-o1はQwen2.5およびLLama-3.1をバックボーンとして使用し、収集したデータを用いて訓練されます。このモデルは、従来のLLMやO1モデルに対して優れた性能を示しました。

3. 結果と考察

DRT-o1は、特に比喩や隠喩を含む文の翻訳においてその効果が顕著であり、長い思考過程を用いることで翻訳の質が向上しています。この研究は、文学的かつ文化的に難解な文の翻訳に対する新しいアプローチを提供し、機械翻訳の分野における重要な貢献となることが期待されます。