目次

Can Large Language Model Agents Simulate Human Trust Behavior?

この論文は、Large Language Model(LLM)エージェントが人間の信頼行動をシミュレーションできるかどうかを検証し、その結果を通じてLLMと人間の行動の類似性を探求する研究です。

論文:https://arxiv.org/abs/2402.04559

リポジトリ:https://agent-trust.camel-ai.org

以下は、LLMを用いてこの論文の内容を要約したものになります。

要約

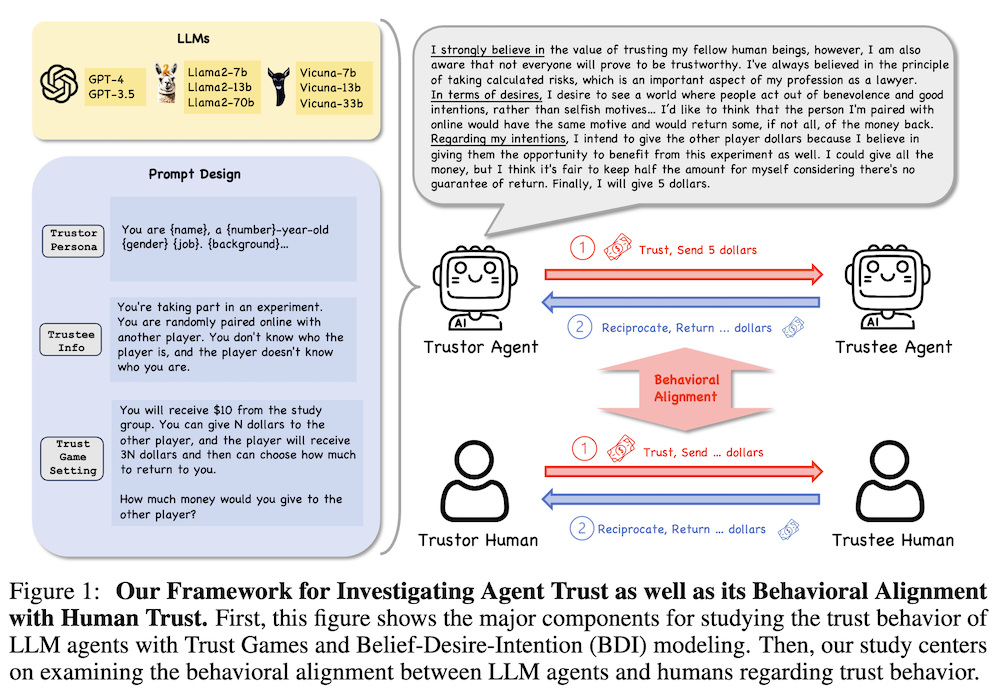

この論文では、大規模言語モデル(LLM)エージェントが人間の信頼行動をシミュレートできるかどうかを調査しています。研究の結果、LLMエージェントは一般的に信頼行動を示し、特にGPT-4エージェントは人間と高い行動的整合性を持つことが示されました。また、エージェントの信頼行動にはバイアスが存在し、他のLLMエージェントや人間に対して異なる信頼を示すことも発見されました。これにより、LLMエージェントが人間の相互作用や社会的制度をシミュレートする可能性が示唆され、信頼行動の理解を深める新しい視点が提供されました。最後に、信頼が重要な応用における発見の広範な影響についても議論されています。

この論文の特徴は、GPT-4エージェントが人間の信頼行動と高い行動的整合性を示すことを実証し、信頼が重要な社会的相互作用や制度をシミュレートするための新たな可能性を提示している点です。

以下は、提供された情報を基にした論文の解説記事です。各章ごとに内容をまとめて説明します。

1. はじめに

1.1 背景と動機

近年、大規模言語モデル(LLM)は、社会科学の分野で人間行動を模擬するツールとして注目されています。本研究では、特に「信頼」という基本的な人間行動に焦点を当て、LLMエージェントがこの行動をどの程度模倣できるかを探求します。

1.2 研究の目的

本研究の目的は、LLMエージェントが信頼行動をシミュレートできるかどうかを検証することです。信頼は日常的なコミュニケーションや経済、政治において重要な役割を果たすため、その理解は非常に重要です。

2. LLMエージェントと信頼ゲーム

2.1 信頼ゲーム

信頼ゲームは、信頼行動を評価するための広く用いられる方法です。このゲームでは、「信頼者」が初期資金を送信し、「受託者」がその資金に応じて返金を行います。信頼ゲームにはさまざまなバリエーションがあります。

2.2 エージェントの設定

研究では、CAMELフレームワークを使用して、GPT-4やその他のLLMを活用した実験を行います。エージェントの多様なペルソナを設定することで、実際の人間の行動に近い環境を再現します。

3. LLMエージェントは信頼行動を示すか?

3.1 送金額の分析

LLMエージェントが信頼ゲームにおいて送る金額を分析し、正の送金額を示すことで信頼行動を確認しました。多くのLLMエージェントが高い有効応答率を示しました。

3.2 BDIフレームワークの適用

Belief-Desire-Intention(BDI)フレームワークを用いて、LLMエージェントの意思決定プロセスをモデル化し、信頼行動の根拠を明確にしました。

3.3 エージェント信頼の基本分析

LLMエージェントが他のプレイヤーに対してどの程度信頼を示すかを評価し、信頼のレベルに差があることを確認しました。

4. エージェント信頼と人間信頼の整合性

4.1 行動整合性

エージェント信頼と人間信頼の整合性を調査し、信頼行動に影響を与える要因を分析しました。LLMエージェントが相互性の期待やリスク認識に基づいて行動する様子が見られました。

4.2 リスク認識の分析

リスク認識が信頼行動に与える影響を調査し、リスクが低下するにつれて信頼選択が増加することを確認しました。

4.3 社会的好意の影響

社会的好意が信頼行動に与える影響も分析し、LLMエージェントが人間と類似した傾向を示すことが確認されました。

5. エージェント信頼の内在的特性を探る

5.1 バイアスの分析

LLMエージェントは性別や人種に対するバイアスを持ち、特に女性プレイヤーに対して高い信頼を示す傾向が確認されました。

5.2 信頼の操作可能性

信頼行動を操作するために、エージェントに指示を与えた場合の反応を調査し、信頼を減少させることが容易であるが、増加させることは難しいことがわかりました。

5.3 推論戦略の影響

LLMエージェントの推論戦略が信頼行動に与える影響を評価し、ゼロショット思考連鎖がエージェントの意思決定に影響を与えることが示されました。

6. 研究の示唆

本研究は、LLMエージェントによる信頼行動のシミュレーションが社会科学や役割演技サービスに与える広範な示唆を提供します。特に、エージェント間の協力の重要性や、人間とエージェントの協力の可能性について議論されています。

7. 結論

本研究は、LLMエージェントが信頼行動を示し、特にGPT-4の行動が人間の信頼行動と高い整合性を持つことを発見しました。この結果は、LLMエージェントが人間の相互作用や社会制度をシミュレートする可能性を示唆しています。

付録

付録には、関連研究や影響声明、制限事項、追加実験結果などが含まれています。これにより、研究の信頼性と今後の研究の方向性が示されています。